Web Scraping proxy là gì? Hoạt động thế nào?

Trong thế giới dữ liệu số ngày nay, việc thu thập thông tin từ các website đã trở thành "vũ khí" sống còn cho mọi doanh nghiệp và cá nhân làm MMO. Tuy nhiên, việc quét dữ liệu không đơn giản là cứ chạy tool là xong. Anh em chắc hẳn đã từng gặp cảnh vừa mới chạy script được vài phút đã bị "ăn gậy" chặn IP hoặc dính CAPTCHA liên tục đúng không? Đó chính là lý do hôm nay Proxy Việt Nam sẽ cùng anh em mổ xẻ về Web Scraping proxy - một giải pháp giúp anh em quét web mượt mà như lướt sóng mà không lo bị "sờ gáy".

Tìm hiểu chi tiết về Proxy Là Gì? Hướng Dẫn Mua Proxy Uy Tín, Tốc Độ Cao

Web Scraping proxy là gì và tại sao anh em cần sử dụng?

Để hiểu một cách đơn giản nhất, Web Scraping proxy là một máy chủ trung gian đứng giữa máy tính của anh em và website mục tiêu mà anh em muốn lấy dữ liệu. Khi anh em thực hiện lệnh quét, yêu cầu sẽ không đi trực tiếp từ IP thật của anh em mà đi qua proxy này. Website mục tiêu sẽ chỉ nhìn thấy địa chỉ IP của proxy, giúp anh em ẩn danh hoàn toàn.

Việc sử dụng Web Scraping proxy không chỉ là để che giấu danh tính. Nó còn là công cụ giúp anh em vượt qua các rào cản kỹ thuật mà các website thiết lập để chống lại bot tự động. Nếu anh em gửi hàng nghìn yêu cầu từ một IP duy nhất trong thời gian ngắn, hệ thống bảo mật của website sẽ ngay lập tức nhận diện đó là hành vi bất thường và chặn quyền truy cập. Với Web Scraping proxy, anh em có thể phân tán các yêu cầu này qua hàng nghìn IP khác nhau, khiến website hiểu nhầm rằng đây là lưu lượng truy cập từ nhiều người dùng thực thụ.

Hơn thế nữa, Web Scraping proxy còn giúp anh em tiếp cận các nội dung bị giới hạn về địa lý. Chẳng hạn, nếu anh em muốn nghiên cứu giá cả của một mặt hàng tại thị trường Mỹ nhưng lại đang ngồi tại Việt Nam, một proxy đặt tại Mỹ sẽ giúp anh em "vượt biên" ảo một cách dễ dàng và chính xác nhất.

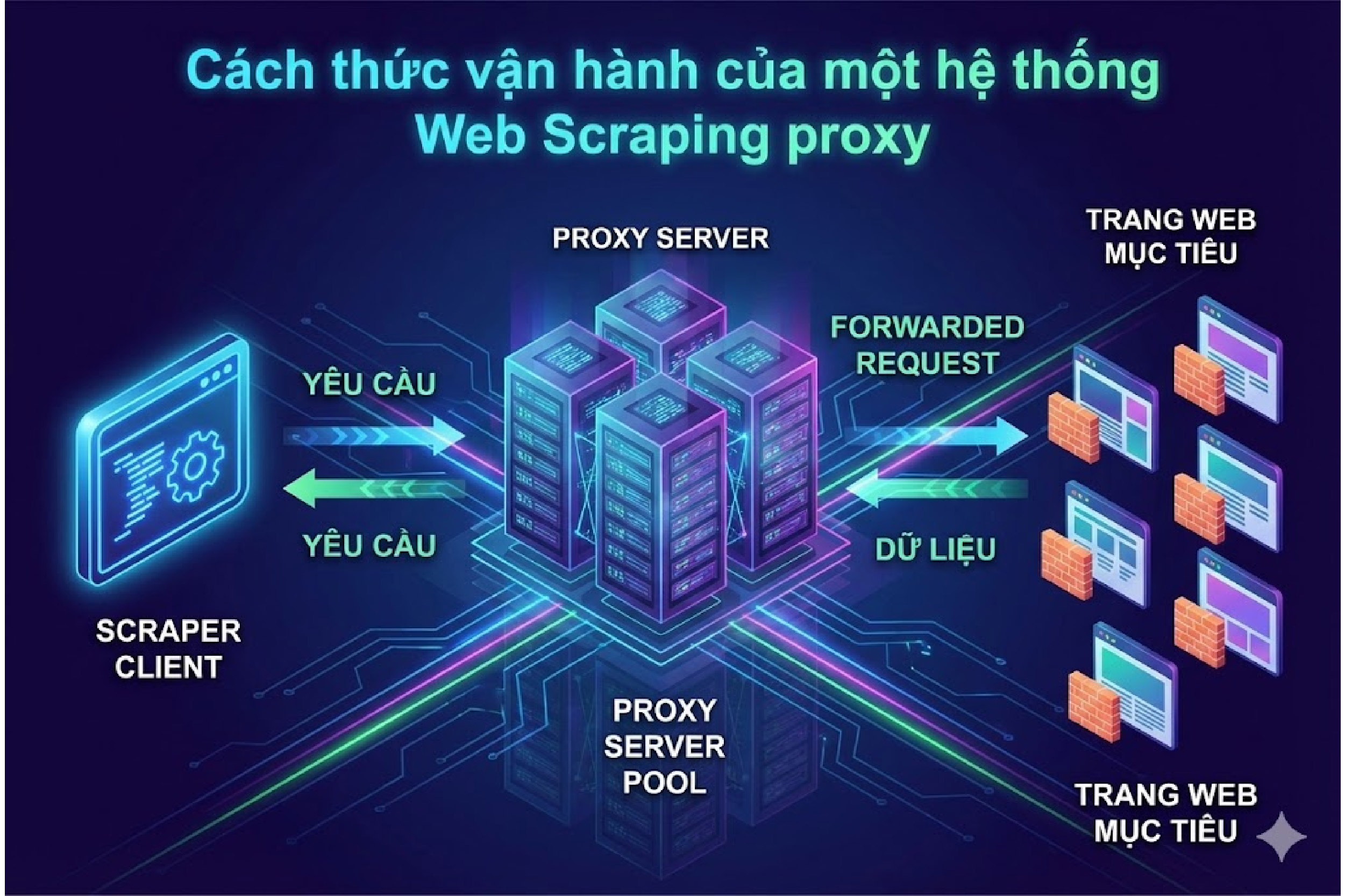

Cách thức vận hành của một hệ thống Web Scraping proxy

Cơ chế hoạt động của Web Scraping proxy thực sự rất thông minh và logic. Khi anh em bắt đầu một dự án quét web, quy trình thường diễn ra theo các bước sau đây:

-

Anh em gửi yêu cầu truy cập dữ liệu thông qua công cụ quét (script hoặc phần mềm).

-

Yêu cầu này được chuyển đến máy chủ Web Scraping proxy.

-

Proxy sẽ thay thế địa chỉ IP thật của anh em bằng một IP từ kho tài nguyên của nó.

-

Proxy gửi yêu cầu đến website mục tiêu.

-

Website mục tiêu phản hồi dữ liệu về cho proxy.

-

Proxy chuyển tiếp dữ liệu đó về máy tính của anh em.

Điểm mấu chốt ở đây là khả năng xoay vòng (rotating). Một hệ thống Web Scraping proxy chất lượng sẽ tự động thay đổi IP sau mỗi yêu cầu hoặc sau một khoảng thời gian nhất định. Điều này làm cho các công cụ chống quét (anti-scraping) của website mục tiêu cực kỳ khó phát hiện ra dấu vết của lưu lượng truy cập tự động, từ đó tăng tỷ lệ thành công cho dự án của anh em.

Những lợi ích thực tế khi anh em sử dụng Web Scraping proxy

Nếu anh em vẫn còn băn khoăn liệu có nên đầu tư vào Web Scraping proxy hay không, hãy điểm qua những lợi ích to lớn mà nó mang lại cho công việc thu thập dữ liệu:

-

Vượt qua rào cản chặn IP: Đây là lợi ích lớn nhất. Anh em có thể thoải mái quét dữ liệu số lượng lớn mà không sợ bị đưa vào danh sách đen.

-

Tránh các thử thách CAPTCHA: Khi lưu lượng truy cập được phân bổ đều qua các IP sạch, các trang web sẽ ít nghi ngờ và không bắt anh em phải giải những mã CAPTCHA phiền phức.

-

Tăng tốc độ thu thập dữ liệu: Thay vì phải chờ đợi giữa các lần gửi yêu cầu để tránh bị chặn, anh em có thể chạy nhiều luồng đồng thời (multi-threading) với hàng trăm IP khác nhau.

-

Đảm bảo tính chính xác của dữ liệu: Nhiều website hiển thị nội dung khác nhau dựa trên vị trí của người dùng. Web Scraping proxy giúp anh em lấy được dữ liệu chính xác theo từng vùng miền cụ thể.

-

Duy trì sự ổn định lâu dài: Với các dự án cần dữ liệu cập nhật liên tục hàng giờ, việc sở hữu một dàn proxy chất lượng giúp hệ thống của anh em vận hành bền bỉ, không bị gián đoạn.

Phân loại các dòng Web Scraping proxy phổ biến trên thị trường

Hiện nay có rất nhiều loại proxy khác nhau, và việc chọn đúng loại Web Scraping proxy sẽ quyết định đến 80% thành công của anh em. Dưới đây là các loại phổ biến mà anh em cần lưu ý:

Proxy trung tâm dữ liệu (Datacenter Proxies)

Đây là loại IP được tạo ra từ các máy chủ trong các trung tâm dữ liệu lớn. Đặc điểm của dòng này là tốc độ cực nhanh và giá thành rất rẻ. Tuy nhiên, vì các IP này thường đi theo dải (range) nên website rất dễ nhận diện và chặn hàng loạt. Anh em chỉ nên dùng loại này cho các website có độ bảo mật thấp hoặc khi cần tốc độ xử lý dữ liệu cực cao mà rủi ro bị chặn không quá quan trọng.

Tìm hiểu chi tiết về: Datacenter Proxy Là Gì? Hướng Dẫn Mua Proxy Datacenter Uy Tín

Proxy dân cư (Residential Proxies)

Đây là "vũ khí hạng nặng" trong làng Web Scraping proxy. Các IP này thuộc về người dùng thật với các thiết bị như máy tính, laptop kết nối qua nhà mạng ISP. Website mục tiêu sẽ nhìn thấy đây là một người dùng thật sự đang truy cập, do đó tỷ lệ bị chặn là cực kỳ thấp. Tuy nhiên, cái giá phải trả cho độ tin cậy này thường cao hơn và tốc độ có thể chậm hơn một chút so với proxy trung tâm dữ liệu.

Tìm hiểu chi tiết về: Proxy cư dân xoay là gì? Tất tần tật cho anh em từ A–Z

Proxy di động (Mobile Proxies)

Proxy di động sử dụng địa chỉ IP từ mạng 3G/4G/5G của các thiết bị di động. Đây là loại proxy có độ uy tín cao nhất hiện nay vì các nhà mạng di động thường dùng chung IP cho rất nhiều người dùng. Website gần như không bao giờ dám chặn các IP này vì sợ ảnh hưởng đến khách hàng thật. Nếu anh em định quét các ứng dụng di động hoặc các trang web cực kỳ khó tính như Google hay Amazon, đây là lựa chọn số một.

Tìm hiểu chi tiết về: Proxy di động là gì?

Proxy xoay vòng (Rotating Proxies)

Thay vì dùng một IP cố định, Web Scraping proxy xoay vòng sẽ tự động thay đổi IP sau mỗi yêu cầu. Anh em không cần phải quản lý danh sách IP một cách thủ công. Hệ thống sẽ tự động làm việc đó, giúp anh em tập trung hoàn toàn vào việc xử lý dữ liệu. Đây là giải pháp cực kỳ hiệu quả cho các tác vụ quét quy mô lớn và liên tục.

Xem thêm bài viết: Proxy xoay và Proxy tĩnh: Hiểu đúng để chọn proxy phù hợp

Proxy chuyên dụng (Dedicated Proxies)

Đúng như tên gọi, đây là những proxy dành riêng cho một mình anh em sử dụng. Anh em không phải chia sẻ băng thông hay lo lắng về việc người khác sử dụng IP đó vào mục đích xấu gây ảnh hưởng đến mình. Loại này mang lại tốc độ và sự ổn định tuyệt vời, rất phù hợp cho các dự án quét web cần duy trì phiên đăng nhập lâu dài.

Tìm hiểu chi tiết: Proxy chuyên dụng

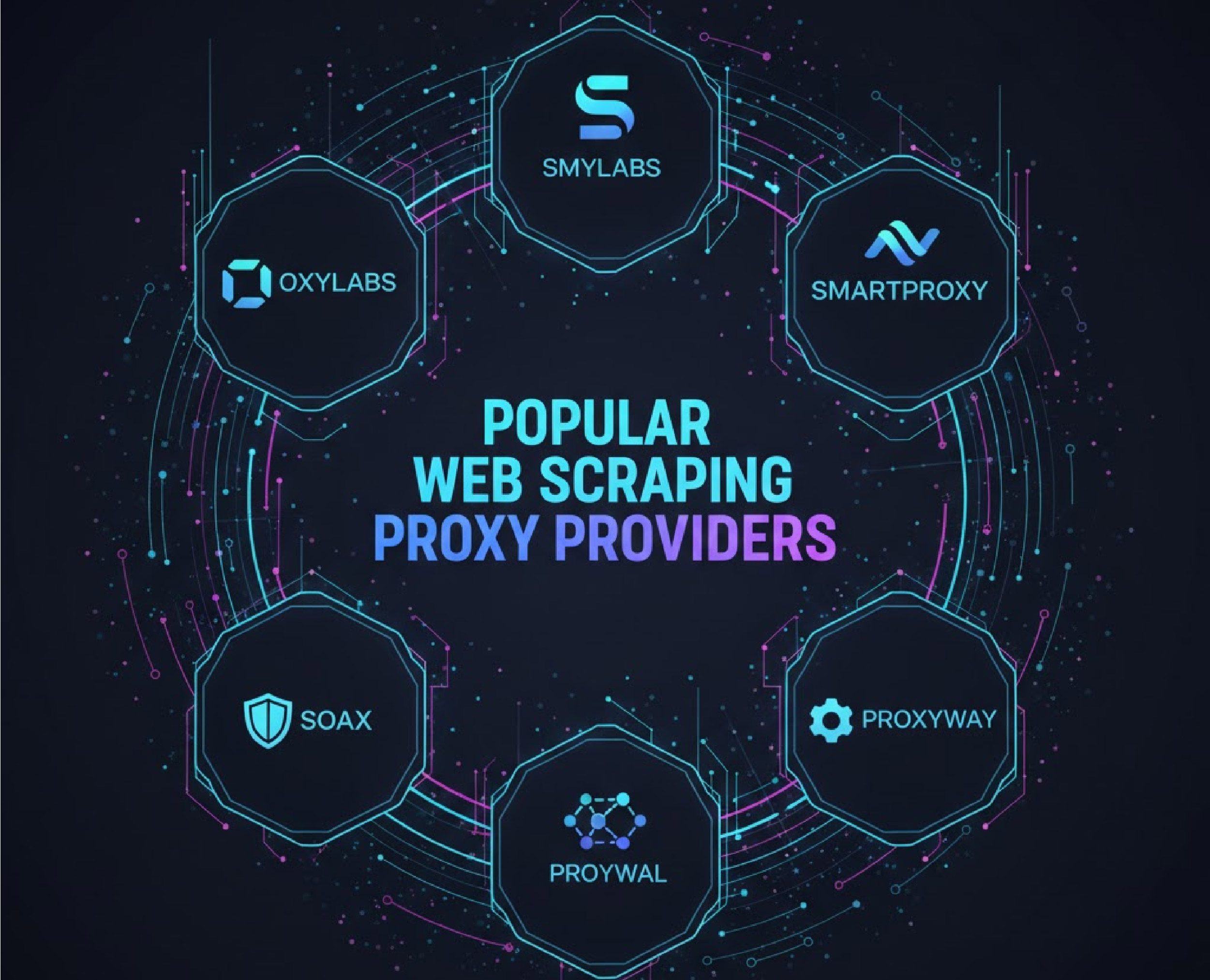

Top các nhà cung cấp Web Scraping proxy uy tín mà anh em nên biết

Để giúp anh em dễ dàng lựa chọn, Proxy Việt Nam xin liệt kê một số cái tên đình đám trong làng cung cấp dịch vụ proxy quốc tế:

-

ProxyVN (Proxy.vn): Lựa chọn số 1 tại Việt Nam với hệ thống proxy cực kỳ ổn định, cam kết không bị "dis" giữa chừng làm gián đoạn công việc. Tốc độ nhanh, giá thành tối ưu so với quốc tế, đây là Web Scraping proxy lý tưởng cho anh em cần hiệu suất cao và sự bền bỉ.

-

IP:Burger Một lựa chọn tuyệt vời cho anh em cần sự ổn định. Họ cung cấp các gói IP dân cư xoay vòng rất mượt, tương thích tốt với hầu hết các công cụ quét hiện nay. Đặc biệt, đội ngũ hỗ trợ của họ rất nhiệt tình.

-

Smartproxy: Nếu anh em mới bắt đầu, đây là một điểm đến lý tưởng. Với hơn 195 quốc gia và giao diện quản lý cực kỳ trực quan, Smartproxy giúp việc thiết lập Web Scraping proxy trở nên đơn giản hơn bao giờ hết.

-

Zyte (trước đây là Scrapinghub): Đây là một ông lớn chuyên sâu về dữ liệu web. Zyte không chỉ bán proxy mà còn cung cấp các giải pháp quản lý proxy thông minh, tự động giải quyết các vấn đề về CAPTCHA và xoay vòng IP.

-

RayoByte: Nhà cung cấp này nổi tiếng với các gói proxy trung tâm dữ liệu chất lượng cao và giá cả cạnh tranh. Thời gian hoạt động (uptime) lên đến 99%, cực kỳ đáng tin cậy cho các dự án lớn.

-

Oxylabs: Một cái tên đẳng cấp dành cho các doanh nghiệp cần quy mô cực lớn. Kho IP của họ khổng lồ và công nghệ AI tích hợp giúp việc quét web gần như không thể bị phát hiện.

Các công cụ và thư viện hỗ trợ Web Scraping proxy hiệu quả

Sau khi đã có trong tay các địa chỉ proxy chất lượng, anh em cần kết hợp chúng với các công cụ mạnh mẽ để bắt đầu thu thập dữ liệu. Dưới đây là những "cánh tay phải" đắc lực:

-

Scraper API: Đây là một dịch vụ giúp anh em đơn giản hóa mọi thứ. Anh em chỉ cần gửi URL cần quét đến API của họ, và họ sẽ lo toàn bộ phần Web Scraping proxy, CAPTCHA và render Javascript.

-

Scrapy: Một framework mạnh mẽ dành cho ngôn ngữ Python. Scrapy cho phép anh em xây dựng các "con nhện" (spiders) để bò khắp website và thu thập dữ liệu một cách khoa học. Việc tích hợp proxy vào Scrapy cũng cực kỳ đơn giản qua các middleware.

-

Beautiful Soup: Nếu anh em chỉ cần quét các trang đơn giản, thư viện Python này là lựa chọn tuyệt vời. Kết hợp Beautiful Soup với thư viện Requests và một danh sách Web Scraping proxy là anh em đã có thể làm chủ dữ liệu.

Tầm quan trọng của SSL và Vị trí địa lý trong việc quét web

Trong quá trình sử dụng Web Scraping proxy, có hai yếu tố kỹ thuật mà anh em không nên bỏ qua là mã hóa SSL và định vị địa lý (Geolocation).

Mã hóa SSL (HTTPS) đảm bảo rằng dữ liệu truyền đi giữa máy tính của anh em và website được bảo mật, tránh bị can thiệp bởi các bên thứ ba. Hầu hết các website hiện nay đều chạy trên giao thức HTTPS, vì vậy proxy của anh em cũng phải hỗ trợ giao thức này để quá trình quét diễn ra trơn tru.

Về định vị địa lý, việc chọn đúng vị trí của Web Scraping proxy giúp anh em có được cái nhìn chính xác nhất về dữ liệu tại thị trường đó. Ví dụ, nếu anh em muốn thu thập dữ liệu SEO, việc sử dụng proxy tại đúng quốc gia mục tiêu sẽ cho kết quả thứ hạng từ khóa chính xác nhất, giúp anh em đưa ra những chiến lược marketing đúng đắn.

Những câu hỏi thường gặp về Web Scraping proxy (FAQ)

Nhiều anh em vẫn còn một vài thắc mắc nhỏ khi bắt đầu, hãy cùng giải đáp nhanh nhé:

-

Dùng VPN hay Proxy để quét web tốt hơn? Proxy thường là lựa chọn tối ưu hơn vì nó nhẹ, dễ dàng cấu hình xoay vòng IP tự động và cho phép chạy nhiều luồng đồng thời tốt hơn VPN.

-

Tôi có thực sự cần proxy để quét web không? Nếu anh em chỉ quét vài trang nhỏ để học tập thì có thể không cần. Nhưng nếu làm việc chuyên nghiệp hoặc quét số lượng lớn, không có Web Scraping proxy thì hệ thống của anh em sẽ bị chặn ngay lập tức.

-

Việc dùng proxy quét web có hợp pháp không? Điều này phụ thuộc vào điều khoản sử dụng của website mục tiêu và luật pháp tại khu vực của anh em. Anh em nên tìm hiểu kỹ và tôn trọng các quy định về robot.txt của website để tránh các rắc rối pháp lý không đáng có.

Tóm lại, việc sử dụng Web Scraping proxy là chìa khóa then chốt để anh em có thể khai thác kho tàng dữ liệu khổng lồ trên Internet một cách hiệu quả và an toàn. Từ việc chọn loại proxy phù hợp cho đến việc sử dụng các công cụ hỗ trợ, mọi bước đều cần sự đầu tư và tìm hiểu kỹ lưỡng. Hy vọng bài viết này đã giúp anh em có cái nhìn tổng quan và sâu sắc nhất về thế giới proxy. Chúc anh em quét web thành công và gặt hái được nhiều dữ liệu giá trị!

Proxy.vn - Nhà cung cấp dịch vụ proxy chất lượng hàng đầu Việt Nam luôn đồng hành cùng anh em trong mọi dự án dữ liệu. Hãy liên hệ ngay với chúng mình nếu anh em cần tư vấn giải pháp proxy tối ưu nhất nhé!